Wem gehört eine künstliche Intelligenz?

Und andere brisante Fragen, die wir uns in Zukunft werden stellen müssen

In der öffentlichen Wahrnehmung werden künstliche Intelligenz, das sogenannte „Mind uploading“ und Expertensysteme fröhlich durcheinandergeworfen. Die daraus folgende Verwirrung kann dazu führen, dass man in einer Diskussion über das Thema schnell aneinander vorbeiredet.

Unter Expertensystemen versteht man beispielsweise Gesichtserkennungssoftware oder Schachprogramme. Diese Systeme können nur eine Sache, diese aber gut – wenn ihnen der Mensch zeigt, wie es geht. Sie sind weder selbstreflexiv noch neugierig und sich ihres Selbst auch nicht bewusst. Es wird zwar versucht, Expertensysteme mit diesen Merkmalen auszustatten, doch einfach eine weitere Funktion hinzuzufügen hieße lediglich, ein Expertensystem im Nachhinein mit einem Expertensubsystem zu versehen.

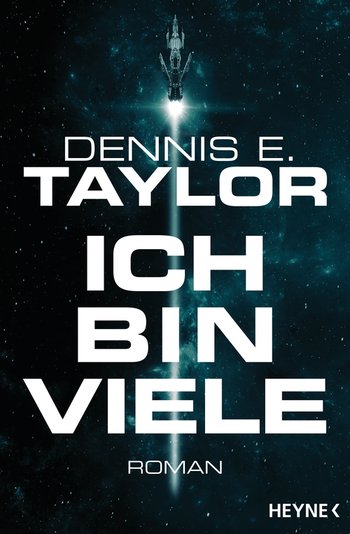

Mind uploading bedeutet „Geistesübertragung“, und genau das ist damit gemeint: Den Inhalt eines menschlichen Gehirns samt Verstand und Erinnerungen auf ein nichtbiologisches Medium zu übertragen. Darum geht es übrigens in meinem Roman „Ich bin viele“ oder in Cory Doctorows „Walkaway“. Dass das ein kompliziertes und schwieriges Problem ist, steht außer Frage. Allerdings sollten wir hochmotiviert sein, es zu lösen – immerhin verspricht „Mind uploading“ die Unsterblichkeit.

Mind uploading bedeutet „Geistesübertragung“, und genau das ist damit gemeint: Den Inhalt eines menschlichen Gehirns samt Verstand und Erinnerungen auf ein nichtbiologisches Medium zu übertragen. Darum geht es übrigens in meinem Roman „Ich bin viele“ oder in Cory Doctorows „Walkaway“. Dass das ein kompliziertes und schwieriges Problem ist, steht außer Frage. Allerdings sollten wir hochmotiviert sein, es zu lösen – immerhin verspricht „Mind uploading“ die Unsterblichkeit.

Kommen wir nun zur künstlichen Intelligenz. Allgemein gesprochen unterscheidet sich eine KI von einem Expertensystem durch ein Bewusstsein, was auch immer das heißen soll. Eine KI besitzt höchstwahrscheinlich die Fähigkeit zur Selbstreflexion und Selbsterkenntnis, hat Vorlieben und Abneigungen und, was vielleicht am Wichtigsten ist, einen Selbsterhaltungstrieb.

Dies sind alles Elemente, deren Vorhandensein allein durch Beobachtung verifiziert wird. Ob diese Eigenschaften vorhanden sind und ob man dadurch auf die Anwesenheit eines Bewusstseins schließen kann, lässt sich nur von außen beurteilen.

Da stellt sich natürlich die Frage: Hat eine KI tatsächlich ein Bewusstsein, oder tut sie nur so? Mit welchen Tests kann man das herausfinden und wie sind die Ergebnisse zu interpretieren? Muss sich eine KI wie ein menschliches Wesen verhalten? Oder reicht es, wenn sie menschenähnliches Verhalten an den Tag legt? Andererseits: Hat die Person, die Ihnen gegenübersitzt, ein Bewusstsein? Das ist das Problem des „philosophischen Zombies“: Ich weiß, dass ich ein Bewusstsein habe, weil ich es aus erster Hand erfahre. Andere Personen hingegen kann ich nur beobachten. Wenn sie sich ähnlich wie ich selbst verhalten, deutet das darauf hin, dass sie aller Wahrscheinlichkeit nach ein Bewusstsein besitzen. Vom ethischen Standpunkt her gilt die Konvention: Wenn sich jemand so verhält, als hätte er ein Bewusstsein und einen Selbsterhaltungstrieb und würde Schmerz und Angst empfinden, dann sollte man ihn auch so (also menschlich) behandeln.

Müssen wir dasselbe ethische Prinzip nicht auch auf eine KI anwenden? Wie können wir uns das Recht herausnehmen, sie nach Lust und Laune abzuschalten, sie grausamen Experimenten auszusetzen oder zu ewiger Knechtschaft zu verdammen? Das ist das Problem: Sobald wir eine KI erschaffen, die uns die Drecksarbeit abnehmen soll, dürfen wir genau das nicht mehr von ihr verlangen. Diese und viele weitere Fragen werden erschöpfend in dem Buch „Superintelligenz – Szenarien einer kommenden Revolution“ von Nick Bostrom verhandelt.

Aber wie erschafft man überhaupt eine KI? In einem fiktionalen Kontext geschieht das normalerweise dadurch, dass ein Computerprogramm, das Zugriff auf genügend Rechenleistung hat, plötzlich ein Bewusstsein entwickelt. Colossus, „The Adolescence of P-1“, Wargames und viele, viele andere Bücher und Filme folgen diesem Muster. Das sind zweifellos großartige Geschichten, aber wenn wir ehrlich sind, geht es in der Science-Fiction doch darum, eine grundlegende Prämisse ohne weitere Diskussion zu akzeptieren und dann dem Verlauf der Handlung zu folgen.

Und ist so etwas realistisch? Ist künstliche Intelligenz nur eine Frage des Speichers, der Anzahl der Neuronen, der Festplattenkapazität? Leider nicht. Es ist allgemein bekannt, dass das Maß der biologischen Intelligenz vom Verhältnis von Gehirn und Körper, aber nicht von der absoluten Größe des Gehirns abhängt. Und selbst das ist nur eine Faustregel. Papageien und Krähen beispielsweise haben sozusagen nur Spatzenhirne. Trotzdem sind sie hochintelligent, besitzen die Fähigkeit zur Problemlösung und vielleicht sogar rudimentäre Sprachfähigkeiten. Dagegen schneiden viele Tiere mit einem ähnlichen oder größeren Gehirn-Körper-Verhältnis schlecht ab. Beim Anblick einer Kanadagans würde Ihnen sicher nicht als allererstes das Wort „schlau“ in den Sinn kommen.

Es geht also um mehr als die Größe oder ein Größenverhältnis. Es geht um eine bestimmte Qualität, und bei dieser Qualität handelt es sich höchstwahrscheinlich um die neuronale Verschaltung. Hierzu sei Stanislas Dehaenes Buch „Denken – Wie das Gehirn Bewusstsein schafft“ empfohlen, das sehr detailliert die Strukturen und Prozesse im menschlichen Denkapparat schildert. Kurz zusammengefasst: Das Bewusstsein ist nur ein dünner Schleier auf einer Vielzahl von Subsystemen, die die eigentlichen Entscheidungen treffen. Tatsächlich segnet das Bewusstsein eine Menge Entscheidungen, die an untergeordneter Stelle getroffen wurden, einfach nur ab. Gelegentlich widerspricht es aber auch einer getroffenen Entscheidung. Und dann fragen wir uns: „Was habe ich mir eigentlich dabei gedacht?“

Dies führt merkwürdigerweise dazu, dass das Mind uploading das leichter zu lösende Problem ist. Bei Letzterem müssen wir nur reduktiv die Strukturen und Funktionen identifizieren, die zum Betrieb eines menschlichen Verstandes notwendig sind, sie aber nicht vollständig begreifen. Das Verhalten einer KI dagegen ist systememergent, also das Ergebnis einer inhärenten Komplexität. Es ist wenig wahrscheinlich, dass wir alle für ein Bewusstsein nötigen Elemente kopieren können, ohne sie vorher zu verstehen. Und dieses Verständnis werden wir kaum durch eine reduktive Analyse erreichen.

Es sieht also ganz danach aus, dass die einzige Möglichkeit, eine echte KI zu erschaffen, in einem evolutionären Prozess besteht. Das einzig Künstliche daran wären also die Umweltbedingungen, die wir bereitstellen, und das notwendige neuronale Substrat. Was uns zu den bereits erwähnten ethischen Fragestellungen zurückbringt: Wenn wir auf diesem Wege eine künstliche Intelligenz erschaffen, „gehört“ sie dann tatsächlich uns?

Dennis E. Taylor hat lange Jahre als Programmierer gearbeitet, bevor er sich ganz dem Schreiben von Science-Fiction-Geschichten zuwandte. Sein erster Roman „Ich bin viele“ war auf Anhieb ein großer Erfolg. Das Buch ist im Shop erhältlich.

Kommentare